史上最大芯片诞生:1.2万亿晶体管超级巨无霸,专为AI设计

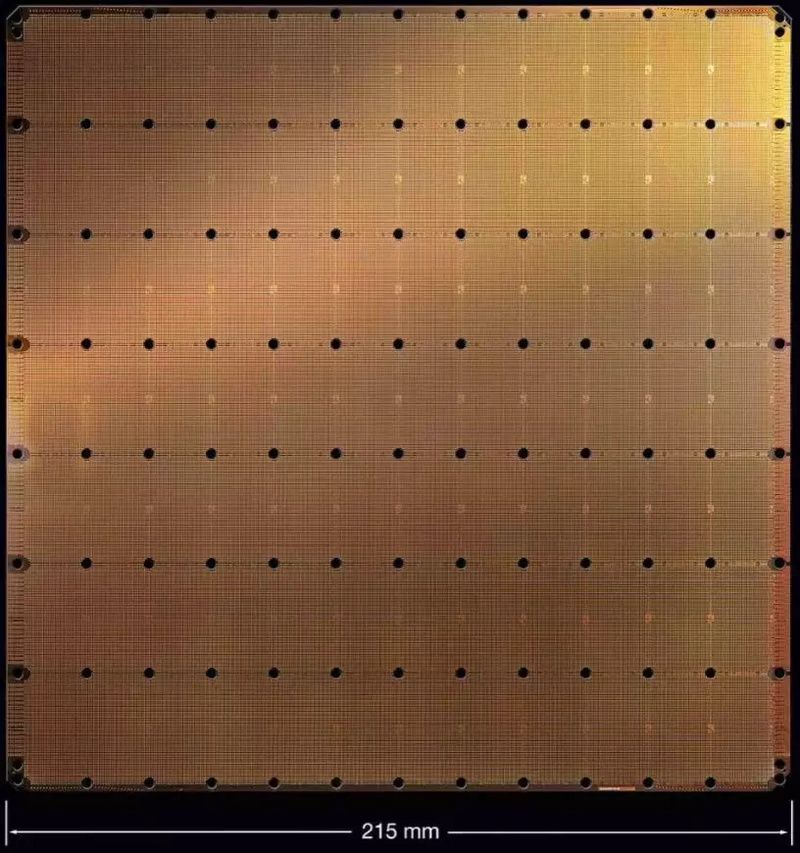

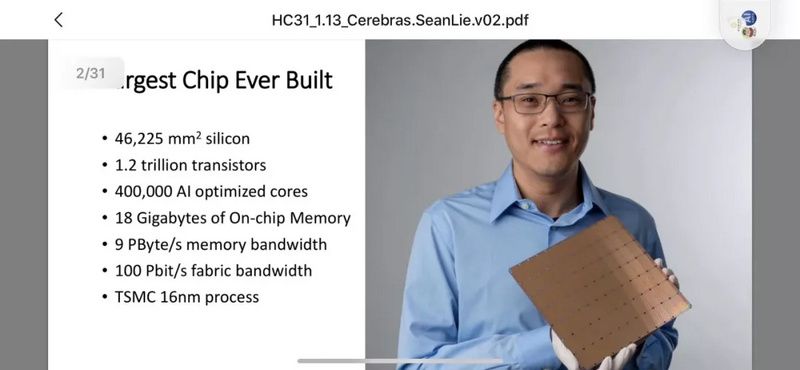

面积42225 平方毫米,拥有1.2 万亿个晶体管,400000 个核心,片上内存18 Gigabytes,内存带宽19 PByte/s,fabric带宽100 Pbit/s。

这就是有史以来最大的芯片——Cerebras Wafer Scale Engine!

这颗巨型芯片由Cerebras Systems公司推出,芯片发布后,三位中国芯片领域专家在朋友圈立即做出评价:

芯片专家唐杉:“膜拜一下Cerebras的巨型芯片,每边大约9英寸,22cm。我记得我之前写文章还画过一个类似的对比图。[机智]Wired的文章,看来Cerebras要走到前台了。”

深鉴科技联合创始人姚颂:“Cerebras的Wafer-scale chip确实壮观,有一种独特的美感,就好像看到大炮巨舰的那种壮丽之情。希望Andrew Feldman一切顺利。”

猎户星空首席战略官王兵:“一万两千亿晶体管的巨大芯片,300mm wafer能做出的最大芯片,挑战芯片行业极限之作。如果能成功必然会颠覆整个AI芯片行业。不过即便是用了多种错误冗余技术,量产良品率还将会是个巨大的挑战。”

Cerebras Wafer Scale Engine拥有1.2万亿个晶体管。1971年英特尔首款4004处理器的晶体管数量为2,300个,最近的AMD处理器拥有320亿个晶体管。

大多数芯片实际上是在12英寸硅晶片上创建的芯片集合,并在芯片工厂中批量生产。但Cerebras Systems芯片是在单个晶圆上互连的单芯片。这些互连设计使这些芯片全部保持高速运行状态,万亿个晶体管可以全部一起工作。

通过这种方式,Cerebras Wafer Scale Engine成为有史以来最大的处理器,它专门设计用于处理AI应用问题。该公司在本周在斯坦福大学举行的Hot Chips会议上讨论这款“世界最大”的芯片的设计。

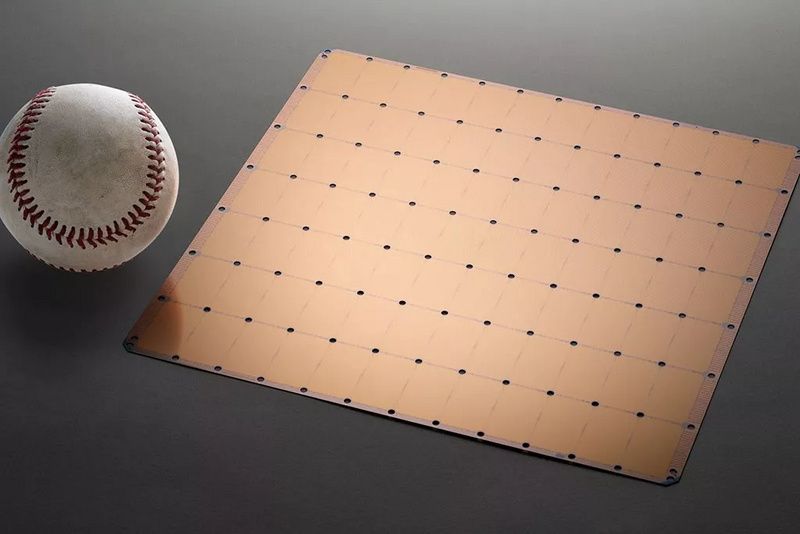

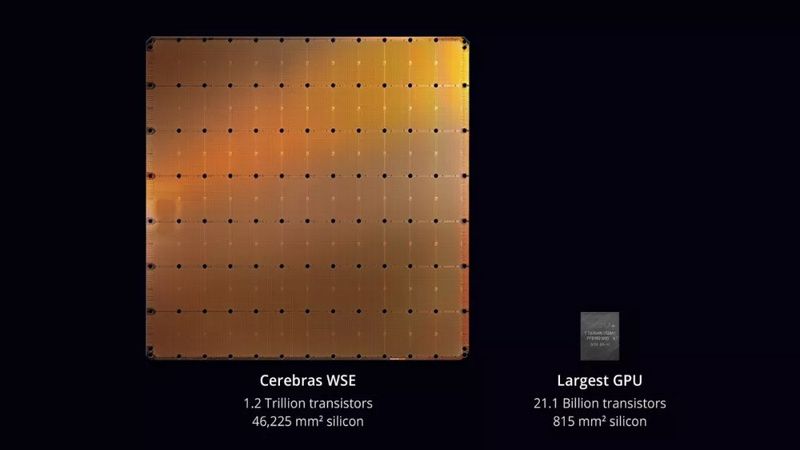

此前,三星实际上已制造出了一个闪存芯片eUFS,拥有2万亿个晶体管。但Cerebras芯片专为流程加工而设计,拥有400,000个核心,芯片面积42,225平方毫米。它比最大的Nvidia GPU大56.7倍,后者尺寸为815平方毫米,含211亿个晶体管。

史上最大芯片跟网球的对比

WSE还包含3,000倍的高速片上存储器,并且具有10,000倍的存储器带宽。

该芯片来自Andrew Feldman领导的团队,后者曾创建微型服务器公司SeaMicro,并以3.34亿美元的价格卖给了AMD。Cerebras Systems的联合创始人兼首席硬件架构师Sean Lie将将在Hot Chips大会上展示Cerebras Wafer Scale Engine。这家位于加州Los Altos的公司拥有194名员工。

Cerebras CEOFieldman与SeaMicro box最初版本合影

芯片尺寸在AI任务中非常重要,因为大尺寸芯片可以更快地处理信息,在更短的时间内给出答案。这能够减少“训练时间”,使研究人员能够测试更多想法,使用更多数据并解决新问题。谷歌、Facebook、OpenAI、腾讯、百度和许多企业都认为,今天制约AI发展的基本限制是训练模型需要的时间太长。因此,缩短训练时间有望消除整个行业取得进步的主要瓶颈。

当然,芯片制造商通常不会制造这么大的芯片。在单个晶片的制造过程中通常会出现一些杂质。如果一种杂质会导致一块芯片发生故障,那么晶圆上的多种杂质就会导致多块芯片出问题。实际制造出的芯片产量仅占实际工作芯片的一小部分。如果晶圆上只有一个芯片,它有杂质的几率是100%,杂质会使芯片失效。但Cerebras设计的芯片留有冗余,一种杂质不会导致整个芯片都不能用。

单晶圆提供超级计算机级的计算能力

“Cerebras WSE”专为人工智能设计而设计,其中包含了不少基础创新,解决了限制芯片尺寸的长达数十年的技术挑战 - 如良品率,功率传送、封装等,推动了最先进技术的发展。和包装,每个架构决策都是为了优化AI工作的性能。结果是,Cerebras WSE根据工作量提供了数百或数千倍的现有解决方案的性能,只需很小的功耗和空间。”Cerebras Systems首席执行官的Fieldman说。

通过加速神经网络训练的所有元素来实现这些性能提升。神经网络是一种多级计算反馈回路。输入在循环中移动速度越快,循环学习的速度越快,即训练时间越短。可以通过加速循环内的计算和通信来加速输入的循环速度。

Cerebras WSE芯片面积比目前最大的GPU大56.7倍, 并提供更多核心进行计算,有更多核心靠近内存,因此内核可以高效运行。由于这些大量的内核和内存位于单个芯片上,因此所有通信都在芯片上进行,通信带宽高、延迟低,因此核心组可以以最高效率进行协作。

Cerebras WSE中的46,225平方毫米的芯片面积上包含40万个AI优化核心,无缓存、无开销的计算内核,以及和18千兆字节的本地化分布式超高速SRAM内存。内存带宽为每秒9 PB。这些核心通过细粒度、全硬件、片上网状连接通信网络连接在一起,可提供每秒100 petabits的总带宽。更多核心、更多本地内存和低延迟高带宽结构,共同构成了面向AI加速任务的最佳架构。

“虽然AI在一般意义上被使用,但没有两个数据集或两个AI任务是相同的。新的AI工作负载不断涌现,数据集也在不断变大,”Tirias Research首席分析师兼创始人Jim McGregor在一份声明中表示。

“随着AI的发展,芯片和平台解决方案也在不断发展。Cerebras WSE是半导体和平台设计方面的一项惊人的工程成就,它在单个晶圆级的解决方案中提供了超级计算机级的计算能力、高性能内存和带宽。”

Cerebras 表示,如果没有多年来与台积电(TSMC)的密切合作,他们不可能取得这个创纪录的成就。台积电是全球最大的半导体代工厂,在先进工艺技术方面处于领先地位。WSE芯片由台积电采用先进的16nm制程技术制造。

400000个AI优化的内核

WSE包含40万个AI优化的计算内核(compute cores)。这种计算内核被称为稀疏线性代数核(Sparse Linear Algebra Cores, SLAC),具有灵活性、可编程性,并针对支持所有神经网络计算的稀疏线性代数进行了优化。SLAC的可编程性保证了内核能够在不断变化的机器学习领域运行所有的神经网络算法。

由于稀疏线性代数内核是为神经网络计算进行优化的,因此它们可实现业界最佳利用率——通常是GPU的3倍或4倍。此外,WSE核心还包括Cerebras发明的稀疏捕获技术,以加速在稀疏工作负载(包含0的工作负载)上的计算性能,比如深度学习。

零在深度学习计算中很普遍。通常,要相乘的向量和矩阵中的大多数元素都是0。然而,乘以0是浪费硅,功率和时间的行为,因为没有新的信息。

因为GPU和TPU是密集的执行引擎——引擎的设计永远不会遇到0——所以它们即使在0时也会乘以每一个元素。当50-98%的数据为零时,如深度学习中经常出现的情况一样,大多数乘法都被浪费了。由于Cerebras的稀疏线性代数核心永远不会乘以零,所有的零数据都被过滤掉,可以在硬件中跳过,从而可以在其位置上完成有用的工作。

比GPU大3000倍的片上内存

内存是每一种计算机体系结构的关键组成部分。靠近计算的内存意味着更快的计算、更低的延迟和更好的数据移动效率。高性能的深度学习需要大量的计算和频繁的数据访问。这就要求计算核心和内存之间要非常接近,而在GPU中却不是这样,GPU中绝大多数内存都很慢,而且离计算核心很远。

Cerebras Wafer Scale Engine包含了比迄今为止任何芯片都要多的内核和本地内存,并且在一个时钟周期内拥有18 GB的片上内存。WSE上的核心本地内存的集合提供了每秒9 PB的内存带宽——比最好的GPU大3000倍的片上内存和10000倍的内存带宽。

低延迟、高带宽的独特通信结构

Swarm通信结构是WSE上使用的处理器间通信结构,它以传统通信技术功耗的一小部分实现了带宽的突破和低延迟。Swarm提供了一个低延迟、高带宽的2D网格,它将WSE上的所有400,000个核连接起来,每秒的带宽总计达100 petabits。

路由、可靠的消息传递和同步都在硬件中处理。消息会自动激活每个到达消息的应用程序处理程序。Swarm为每个神经网络提供了一个独特的、优化的通信路径。软件根据正在运行的特定用户定义的神经网络的结构,配置通过400,000个核心的最优通信路径,以连接处理器。

典型的消息遍历一个具有纳秒延迟的硬件链接。一个Cerebras WSE的总带宽是每秒100 PB。不需要TCP/IP和MPI等通信软件,因此可以避免性能损失。这种结构的通信能量成本远低于远低于每比特 1 焦耳,比GPU低了近两个数量级。结合了巨大的带宽和极低的延迟,Swarm通信结构使 Cerebras WSE比任何当前可用的解决方案学习得更快。

原文链接:

https://venturebeat.com/2019/08/19/cerebras-systems-unveils-a-record-1-2-trillion-transistor-chip-for-ai/amp/?from=timeline