AI换脸背后的技术攻防战

核 心 要 点:

▪合成视频触达了许多人的心理底线:当视频也可以被伪造,还有什么可以甄别真实?

▪为了提高人脸识别的安全性,研究者们已经做出了诸多尝试和努力。

▪除了人脸识别之外,还有多种生物识别技术可供进行个人身份鉴定。

经过一个周末的集中爆发,换脸软件ZAO的热度终于有所降温。它应用的技术并不新鲜,却让人脸合成视频第一次离普通用户这么近。

广被诟病的用户协议、合成视频存在的安全问题使得ZAO深陷舆论漩涡——从爆红到质疑缠身,只用了不到24小时。

但是,对ZAO的担忧与抵制并不能解决普通人隐私、安全存在风险的问题。从人脸合成技术诞生的那一天开始,人们就没有停止过对技术被人利用去作恶的忧虑。

人脸合成只是当下备受追捧的人工智能领域的一个分支,技术在为人类带来诸多新奇体验、便利的同时,也给个体带来对于自身诸多权益被侵犯的担忧。

当人类制造的技术越来越强大,甚至无所不能,人类本身的领地和独特性如何维护便成为值得思考的问题。如今,人工智能的发展渐成加速之势,这个情况甚至超出了不少人最乐观的估计,潘多拉的盒子已被打开。

「被引爆的隐私担忧」

在朋友圈刷屏,ZAO有许多前辈:脸萌、足记、天天P图……与ZAO一样,这些曾经刷屏的应用大多与图像相关,许多也需要用户上传个人照片,但是从未引起如此规模的争议和质疑。

能够合成视频是ZAO引爆公众讨论的关键:在此之前,图像APP的玩法都是基于静态的照片,ZAO则是第一次将视频换脸带到了每一个普通用户身边。

事实上,在计算机视觉领域,生成一张图片的技术早已有之:把A的脸抠出来贴在B的脸上,Photoshop也可以完成。只是在深度学习的帮助下,程序可以快速、大量的P图。而视频人脸合成,实际上就是先生成一个视频序列的所有帧,之后加入检测或视频序列技术,进而生成人脸合成视频。

合成视频,这触达了许多人的心理底线:当视频也可以被伪造,还有什么可以甄别真实?

无论是今年6月被篡改的马克•扎克伯格的视频,还是被嫁接了美国女星面孔的色情视频,都足够引发大众对于视频真实、安全性的担忧。比如犯罪分子伪装子女声音向父母勒索的案例已经发生,在人脸合成的帮助下,视频验真也已经无法确定事实的真相,正如有些网友提醒的:“有手机号,有面部图像,通过技术合成,犯罪分子可以替你和家人通话。”

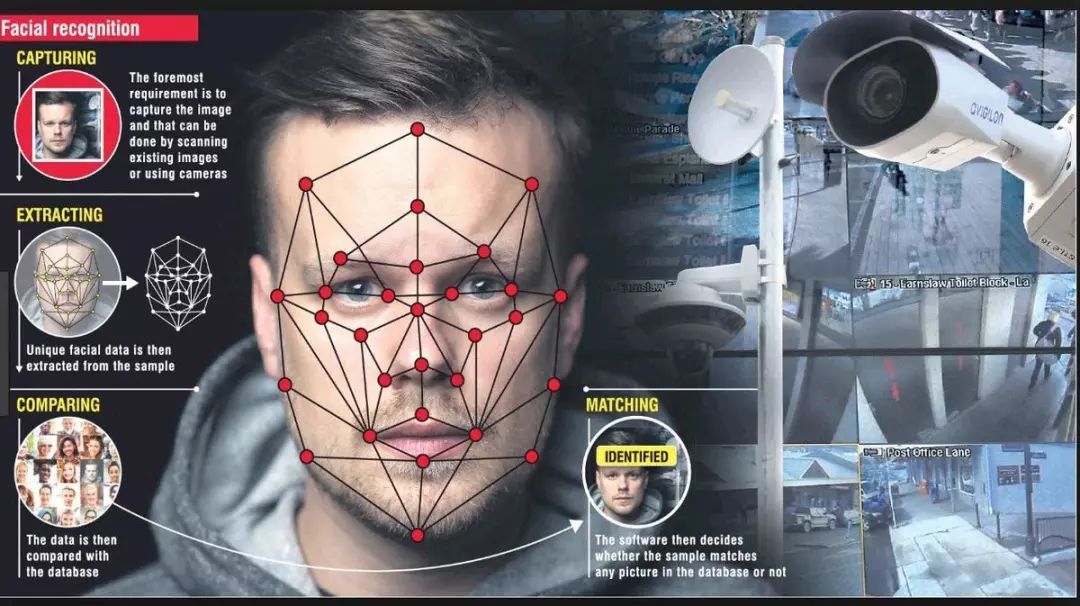

大部分人并不会遇到上述极端情况,但人脸识别的广泛应用使得人脸合成有了更多可以想象的发挥空间。当人脸合成被装进手机应用中,成为每一个人都触手可及的技术时,类似的担忧无疑会被放大,在安防、支付、考勤、刑侦等领域,愈加真实、无破绽的人脸合成技术,的确会带来不少安全隐患。

好在,围绕人脸识别的攻防战早已拉开帷幕,多次交手后,技术升级后的人脸识别并不那么容易被攻破。

「技术攻防战」

人脸合成只是计算机视觉研究的一个细分方向,作为一门致力于让机器看懂物体的科学,计算机视觉研究诞生已久。1966年,人工智能学家Minsky给学生布置了一个作业:编写一个程序让计算机告诉我们它通过摄像头看到了什么,这被认为是计算机视觉最早的任务描述。而计算机视觉之所以在今天能诞生如此多新奇有趣的应用,与深度学习的发展密不可分。

2006年,深度学习泰斗Geofrey Hinton在《Science》发表了论文《A fast learning algorithm for deep belief nets》,推动了持续至今的人工智能浪潮。

深度学习在国内业界的普及则与百度密切相关。

得益于此,人工智能相关应用在过去几年迅猛增长。其中,人脸识别是应用范围比较广的技术之一。如今,在金融、安防、考勤等领域,人脸识别已被大量应用。比如,当用户向互联网金融公司借贷时,平台首先需要做的是“验证你是你”,由于与钱直接相关,拦截伪造的人脸攻击就变得至为重要。

2018年7月,旷视科技产品总监彭建宏曾在一节网络公开课中表示:在人脸识别领域,目前比较流行的攻击方法主要包括:图片攻击

(使用合法用户的纸质打印照片、彩色打印照片、手机里保存的照片等欺骗,属于非活体攻击)

、视频攻击

(提前录制的视频回放,包含眨眼、转头、张嘴等动作指令欺骗,属于活体攻击)

、立体面具攻击

(利用事先伪造的面具欺骗,属于非活体攻击)

等几种方法。

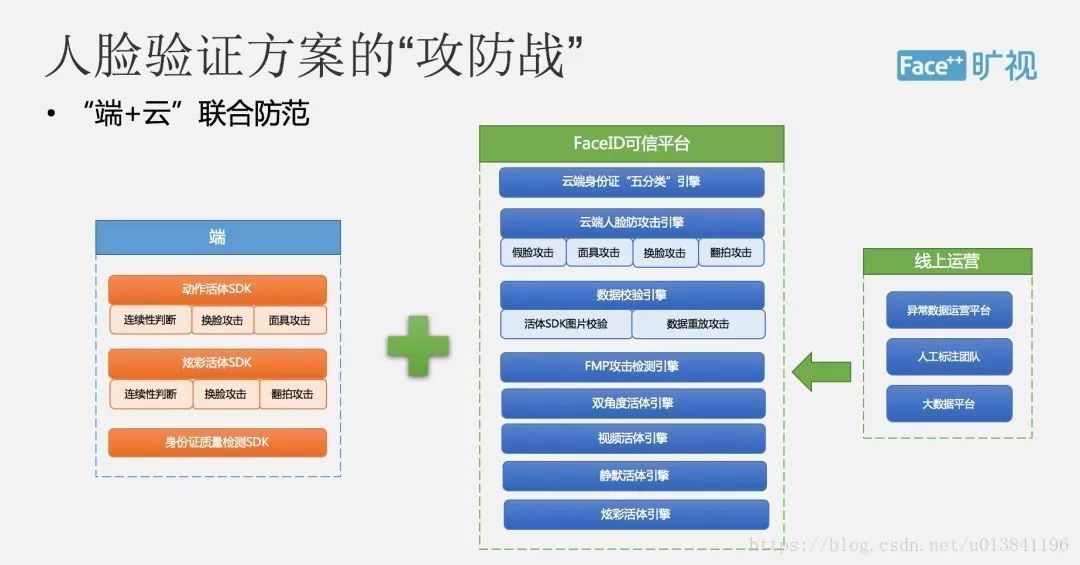

而研究者们最为重视的是可以应对活体攻击的检测方案,包括动作活体检测、视频活体检测、炫彩活体检测、双角度活体检测等几种类型。

●动作活体检测:要求用户根据UI提示做点头、摇头等随机动作,每次的随机动作都是从计算机 Servers 端发出的,计算机通过人脸质量检测、人脸关键点的感测和跟踪,以及脸部的 3D 姿态等技术细节提高人脸识别的精准度。

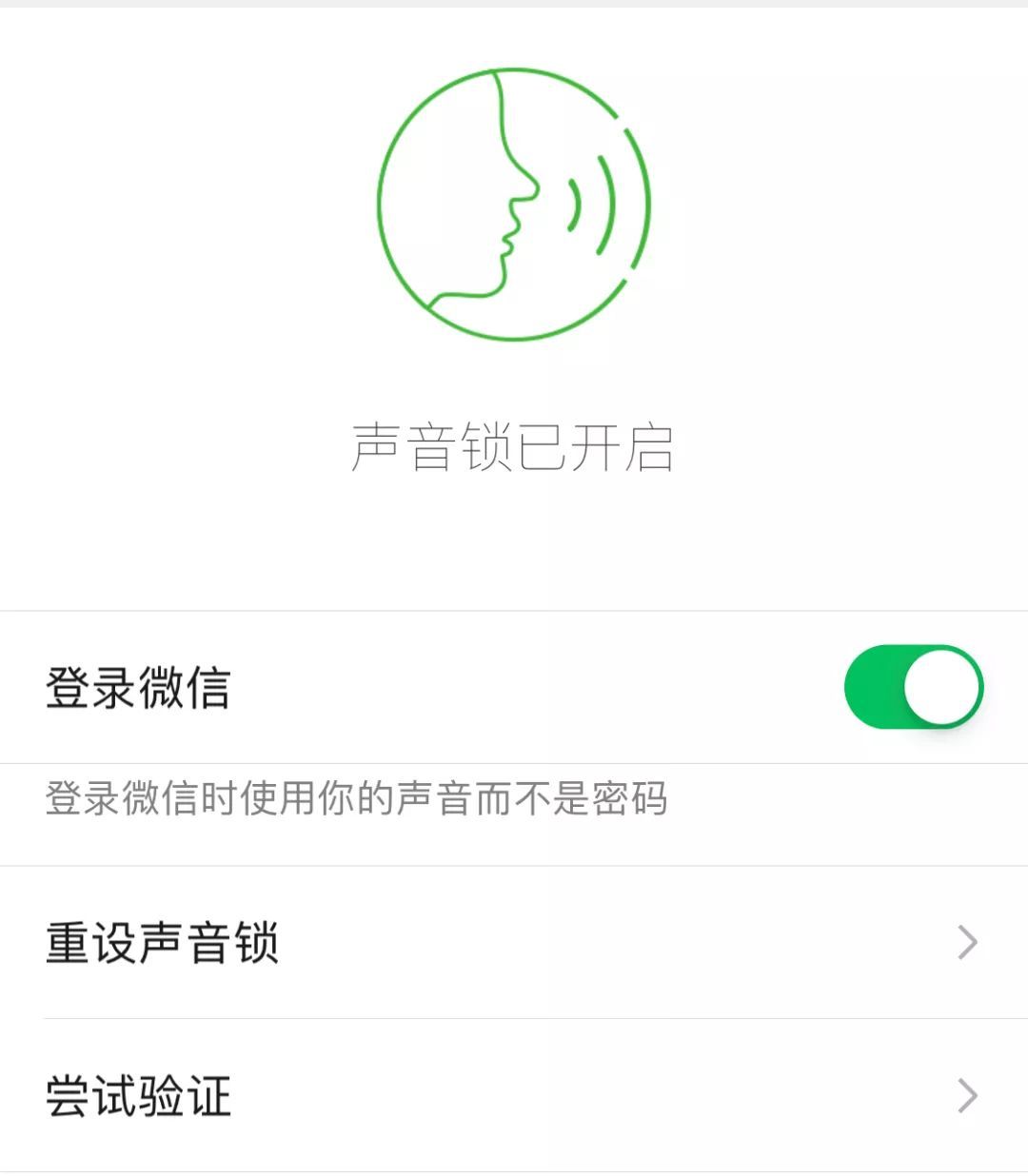

●视频活体检测:主要针对移动 H5 的场景,要求用户根据 UI 提供的内容读一个四位数字,计算机通过云识别、语音同步检测等方法判断被检测的人脸是否真实。

●炫彩活体检测:根据反射光三维成像的原理,杜绝了用 3D 软件合成的视频、屏幕翻拍等的攻击。在强光环境下,炫彩活体的检测效果不太好,因此可能需要用户最后做出一个简单的点头动作,以提高活体攻击的门槛。

●双角度活体检测:要求用户拍一张正脸的自拍照与侧面自拍照,这种检测方式相当于用户拍摄一个1-2秒钟的视频,计算机通过 3D 模型重建的方式来判断视频中是否为真人。

●静默活体检测:不需要用户做任何动作,自然面对摄像头3、4秒钟即可。由于真实人脸并不是绝对静止的,而是存在微表情,如眼皮眼球的律动、眨眼、嘴唇及周边面颊的伸缩等,计算机则可通过此类特征反欺骗。

各个公司运用的活体检测方法各不相同,最常用的是摩尔纹(

在数码照相机或者扫描仪等设备上,感光元件出现的高频干扰的条纹,是一种会使图片出现彩色的高频率不规则的条纹)

。不过对于伪造的人脸面具,摩尔纹也无法识别。这个时候,只有通过给机器输入大量人脸面具的图片,让机器找出面具特征,再结合摩尔纹才能有效拦截。

旷视科技的彭建宏也提到,基于云端大量人脸数据训练出的 FMP 深度神经网络,能够根据线上数据实时返回和调整,从而不断提高识别准确率,实现有效识别翻拍及面具攻击。

「除了人脸,守住真实防线的武器还有哪些?」

证明你是你,脸并不是唯一的标记物。

生物识别一般是通过与光学、声学、生物传感器和生物统计学原理等高科技手段密切结合,利用人体固有的生理特性和行为特征来进行个人身份的鉴定。由于具有不会丢失、不易遗忘、防伪性能好等特点,生物识别被获得了研究者的重视,其中指纹识别、虹膜识别等识别方式已经有了较为广泛的应用。

●

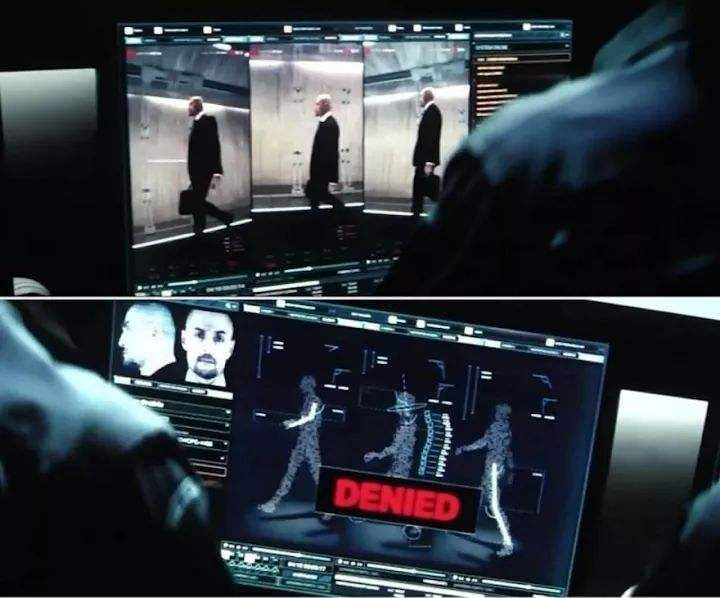

步态识别:旨在通过人们走路的姿态进行身份识别。由于它不需要人的行为配合,很难伪装,所以特别适合于远距离的身份识别。步态识别的采集装置简单、经济,甚至只需要一个监控摄像头。当前国内步态识别领域的企业中,名气最大的是银河水滴。

●掌静脉识别:首先通过静脉识别仪获取手指、手掌、手背静脉的图像,然后将捕获的掌静脉分布图存贮在计算机系统中供后续识别使用。掌静脉识别简便易用、识别快速,准确度还很高。然而,由于掌静脉识别的产品有难以小型化、制造成本高、对采集设备有特殊要求等缺点,目前应用并不广泛。当下国内知名的企业有富士通、通元微智能科技和智脉科技等几家。

上面的每一种识别方式都曾以不同面目在电影中炫酷出镜过,比如《谍中谍5》中,“步态识别”成为阿汤哥一行人获取情报的最大障碍。

根据量子位的报道,斯坦福和普林斯顿大学等最新研究:给定任意文本,就能随意改变一段视频里人物说的话。并且,改动关键词后人物口型还能对得奇准无比,丝毫看不出篡改的痕迹——AI也能造假声音了。

「不容忽视的AI伦理」

换脸软件 ZAO 将人工智能时代的隐私问题暴露的更加彻底:当用户完成面部照片上传,制作好换脸视频并发布到社交网络之后,不仅可能侵犯了他人的肖像权、名誉权和著作权,而且意味着他们已经成了“透明人”,隐私权荡然无存。

微信创始团队成员,支付宝前资深产品经理陆树燊就表示,照片泄露已经是公开的秘密。不管用户使用的是苹果手机还是安卓手机,理论上只要曾经在App上打开过相机或者选择过相机,并使用一段时间,用户的相册里面的各种照片对App运营者来说就不是秘密了。而用户的手机号和照片同时泄露给App,更是很早就存在的事情,这个信息安全问题几乎没有得到过重视。

“至于大家能做什么,实则有限。如果你的手机相册里存有身份证正反面的照片,记得把本地和云端的备份都删掉。”

可以料想的是,就像脸萌、足记、天天P图一样,刷屏朋友圈的ZAO迟早有一天热度会消散,但由于其将前沿的AI技术带到了普罗大众面前,由此引发的隐私、安全争议也让人们对AI未来走向的探讨更加激烈。

但得到这些好处并非没有代价,ZAO引发的争论只是人工智能技术B面的一小部分,面对这股强大且未知的力量,围绕人工智能伦理的探讨从未停歇。

对人工智能的伦理探讨主要有以下几个议题。

一是算法歧视。

算法决策其实是一种预测,用过去的数据预测未来的趋势,算法模型和数据输入决定着预测的结果。但在某些时候,算法并不客观,而是暗藏歧视。比如,一些图像识别软件之前将黑人错误地标记为“黑猩猩”或者“猿猴”。

微软在Twitter上线的聊天机器人Tay在与网民互动过程中,曾成为过一个集性别歧视、种族歧视等于一身的“不良少女”,这揭示了更深层的问题:因为错误的输入,形成了错误的输出,错误的输出作为反馈,又进一步加深错误。

过去的歧视可能会在算法中得到巩固并在未来得到加强,简而言之:恶性循环。

二是隐私忧虑。

很多人工智能系统都需要大量的数据来训练学习算法,数据因此成为AI时代的“新石油”,这带来了新的隐私忧虑。

三是如何界定AI的人道主义待遇。

当自主智能机器人越来越强大,它们在人类社会到底应该扮演什么样的角色,目前还无法确定。

此外,越来越多的教育类、护理类、服务类的机器人在辅助人类看护孩子、老人和病人,这些交互会对人的行为产生什么样的影响,也需要得到进一步研究。

四是责任与安全的保障。

埃隆·马斯克、史蒂芬·霍金之前都提醒人们要警惕强人工智能或者超人工智能可能会威胁人类生存,但科学界和社会大众对这个问题的讨论和认识还停留在表层。

马斯克屡次提出警告:人工智能技术未来或将导致人类走向毁灭。他曾表示,“人工智能的关键在于,它们并不是机器人,而是一种计算机算法。机器人只是一堆传感器元件,而人工智能则构成了强大的网络。如果只是算法失控,人类和人工智能便可以携手加以控制。但一旦集中化的大型人工智能系统决意攻占世界,我们就无力阻止了。”

为此,马斯克号召人们做好准备,应对人工智能带来的“世界末日”。他提出,人类和机器可以融合为一种“人工智能-人类”的共生生物,这样便能有效杜绝“人工智能独裁”局面的出现。

2014年,霍金在接受英国广播公司的采访时说,“我们已经拥有原始形式的人工智能,而且已经证明非常有用。但我认为人工智能的完全发展会导致人类的终结。

一旦经过人类的开发,人工智能将会自行发展,以加速度重新设计自己。

由于受

到缓慢的生物演化的限制,人类不能与之竞争,最终将会被代替。

”

马斯克说自己并不是一个天然乐观或悲观的人,但他依然对人与人工智能的未来持有悲观的态度:“人工智能可能比最聪明的人还要聪明。计算机可以用超过人类几十万倍数字通量的方式进行对话,计算机看人一定会觉得特别无聊。”他建议,如果人类打不过人工智能的话,可以和他们组成团队。

而马云的态度就很乐观,他不觉得人工智能是一种威胁,“我不认为人工智能是很恐怖的东西,因为人类很聪明。人工智能很好、很有意思,我们会拥抱它。今天很多问题没有解决方案,但是未来会有,青年人会有解决方案。”

人工智能与人类未来究竟会如何相处——是马斯克预言的悲观结局,还是马云预言的乐观结局,在肉眼可见的时间里,我们暂时还看不到答案。